OpenClaw

Kết nối OpenClaw với AI GuardRails

Thêm lớp bảo mật trung gian giữa OpenClaw và nhà cung cấp LLM để bảo vệ PII, phát hiện prompt injection và kiểm duyệt nội dung.

Kết nối OpenClaw với AI GuardRails

Tổng quan

AI GuardRails thêm lớp bảo mật trung gian giữa OpenClaw và các nhà cung cấp LLM. Nó cung cấp bảo vệ PII, phát hiện prompt injection, phát hiện bí mật và kiểm duyệt nội dung — đảm bảo tác nhân AI của bạn hoạt động an toàn.

Điều kiện tiên quyết

- OpenClaw đã triển khai và đang chạy (xem Cài đặt)

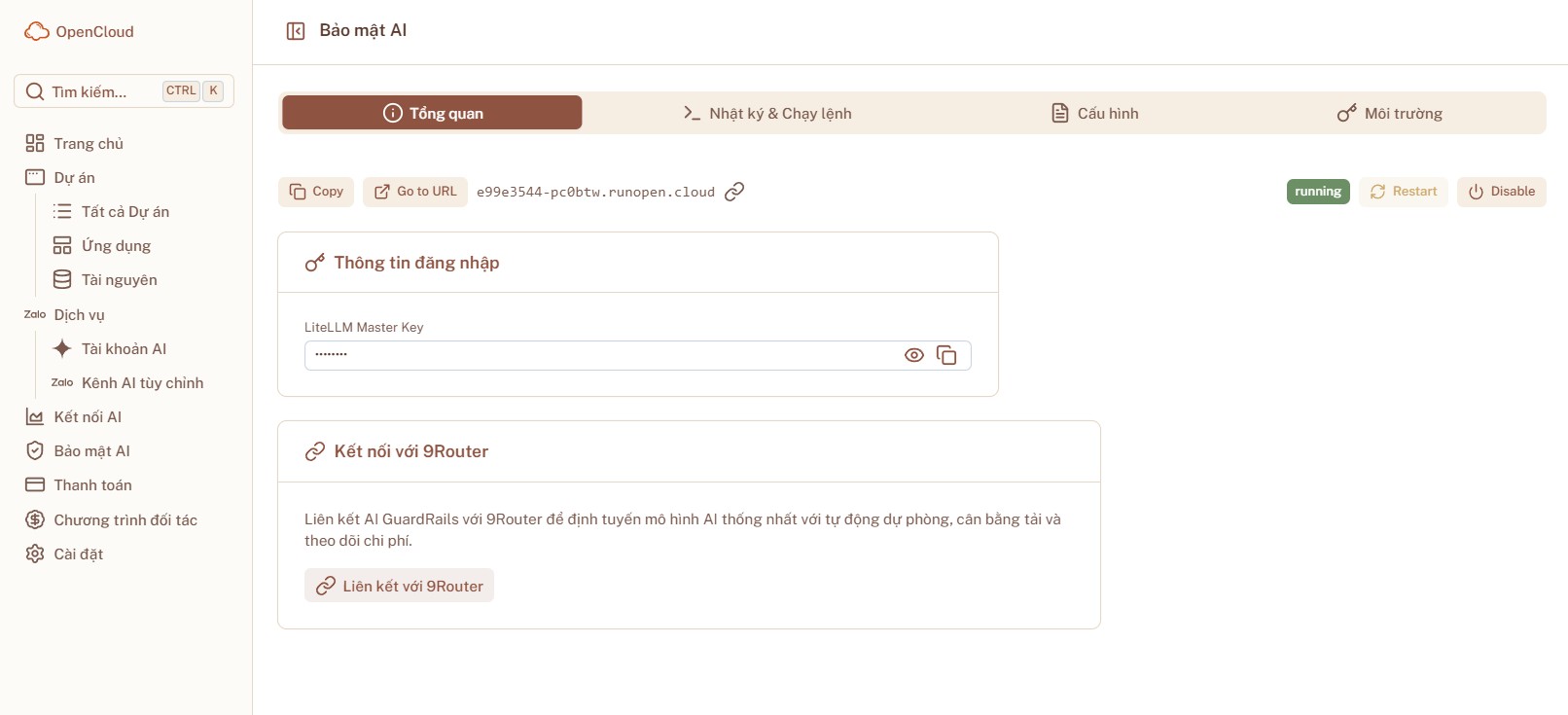

- Addon AI GuardRails đã triển khai (xem Bảo mật AI)

Các bước

- Triển khai AI GuardRails

Vào dự án > mục Bảo mật AI và triển khai AI GuardRails. Chờ cho đến khi nó hoạt động. - Cài đặt nhà cung cấp trong AI GuardRails

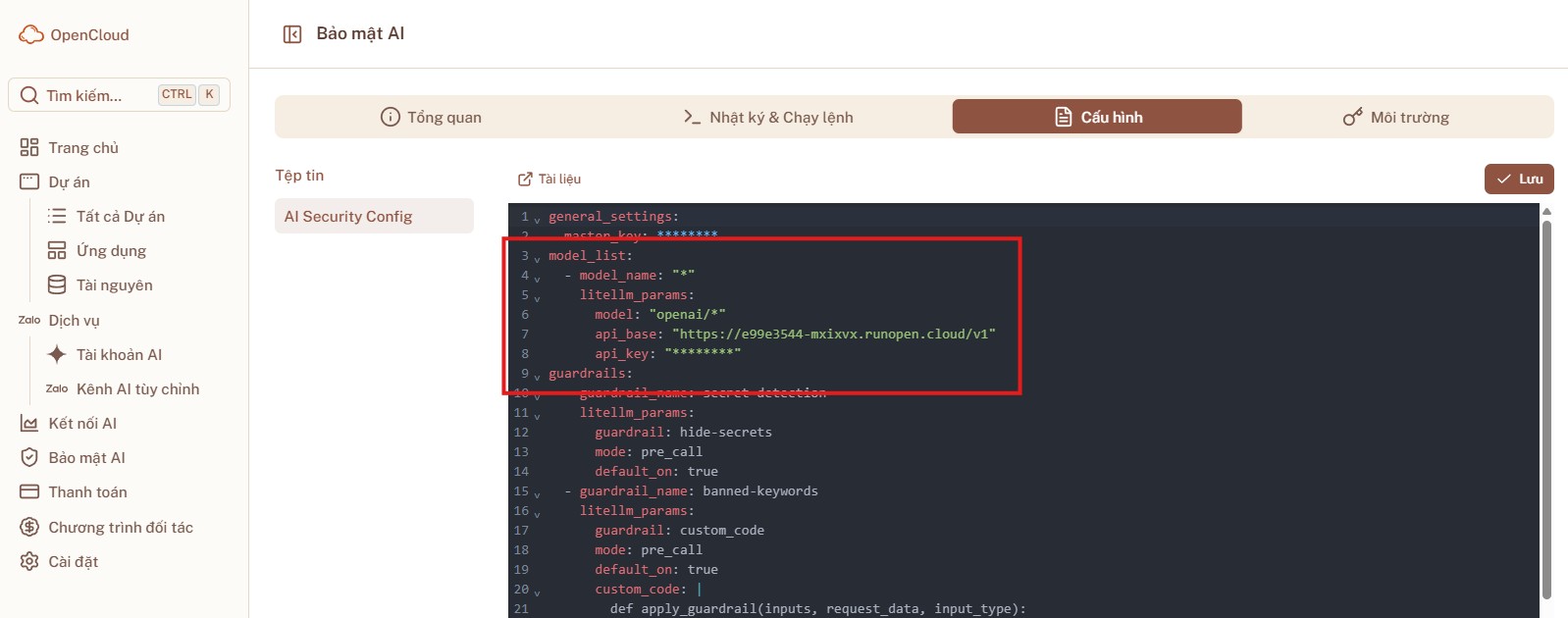

Từ Bảo mật AI > Cấu hình, thêm API key và endpoint của nhà cung cấp LLM bạn đang sử dụng. Điều này cho phép GuardRails định tuyến yêu cầu qua nhà cung cấp và áp dụng các chính sách bảo vệ.api_base: URL endpoint của nhà cung cấp LLMapi_key: API key của nhà cung cấp LLM

model_list: - model_name: "*" litellm_params: model: "openai/*" api_base: "YOUR_LLM_ENDPOINT" api_key: "YOUR_LLM_API_KEY"

Nêu bạn đang sử dụng 9Router, hãy sử dụng endpoint và API key của 9Router làm nhà cung cấp trong GuardRails. - Lấy endpoint và API key GuardRails

Từ Bảo mật AI > Tổng quan AI GuardRails, sao chép URL endpoint và API key. Nó sẽ có dạng:http://<project-id>.runopen.cloud

- Định tuyến OpenClaw qua GuardRails

Vào ứng dụng OpenClaw > Environment Variables và cập nhật:"models": { "providers": { "litellm": { "baseUrl": "YOUR_GUARDRAILS_ENDPOINT", "apiKey": "YOUR_GUARDRAILS_API_KEY", "api": "openai-completions", "models": [] } } }, "agents": { "defaults": { "model": { "primary": "litellm/your-model-name" }, "workspace": "/data/workspace" } },

- Cấu hình chính sách bảo vệ

Mở bảng điều khiển AI GuardRails và cấu hình:- Phát hiện PII — Tự động ẩn thông tin cá nhân

- Phát hiện Prompt Injection — Chặn các prompt độc hại

- Phát hiện bí mật — Ngăn API key bị lộ trong phản hồi

- Kiểm duyệt nội dung — Lọc nội dung không phù hợp

- Khởi động lại OpenClaw

Lưu biến môi trường và khởi động lại ứng dụng.

Kiểm tra GuardRails

- Gửi tin nhắn đến OpenClaw chứa PII thử nghiệm (ví dụ: số điện thoại giả)

- Kiểm tra bảng điều khiển GuardRails để xem nó có phát hiện và xử lý không

- Xác minh phản hồi được lọc đúng cách

Lợi ích

- Bảo vệ PII — Tự động phát hiện và ẩn dữ liệu cá nhân

- An toàn Prompt — Chặn tấn công injection trước khi chúng đến LLM

- Nhật ký kiểm tra — Ghi lại tất cả hành động guardrail để tuân thủ quy định

- Chính sách có thể cấu hình — Tinh chỉnh những gì bị chặn so với được cho phép

Để xem hướng dẫn đầy đủ về cấu hình AI GuardRails, xem Bảo mật AI.