AI Security

AI Security

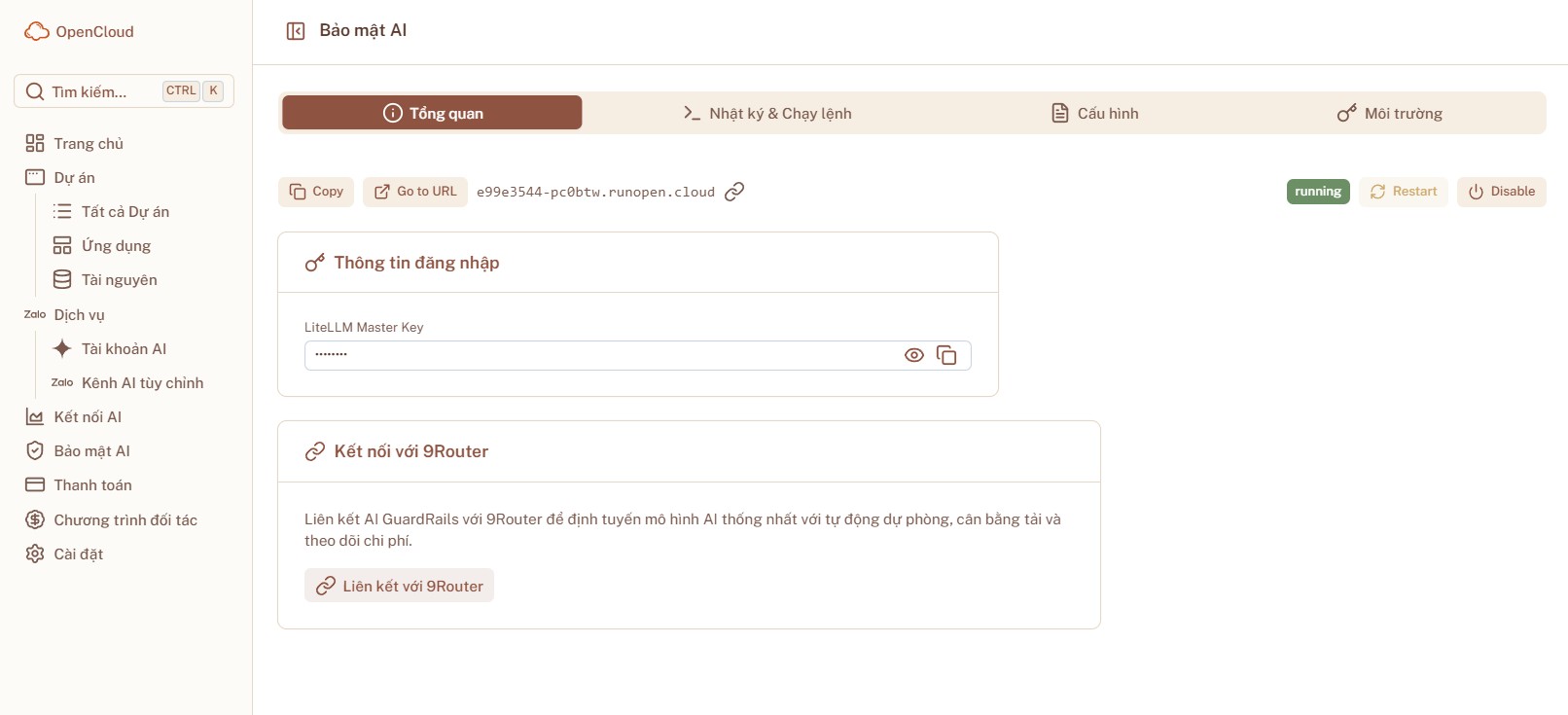

Trang AI Security cho phép bạn cấu hình chính sách bảo mật và kiểm soát truy cập cho các triển khai AI. Giúp bạn bảo vệ API key AI, kiểm soát chi phí và đảm bảo sử dụng mô hình AI an toàn.

OpenCloud sử dụng LiteLLM làm nền tảng cho AI Security. LiteLLM là phần mềm trung gian bảo mật AI mã nguồn mở, hoạt động như một cổng bảo vệ giữa ứng dụng và mô hình AI, cung cấp API thống nhất để truy cập 100+ mô hình AI đồng thời thêm các guardrails an toàn.

Ứng dụng của bạn → AI Security (LiteLLM) → OpenAI, Anthropic, Google, v.v.

Tại sao AI Security quan trọng

Khi sử dụng dịch vụ AI:

- API key rất có giá trị — Nếu bị đánh cắp, ai đó có thể tạo ra chi phí lớn trên tài khoản nhà cung cấp AI của bạn

- Chi phí có thể tăng nhanh — Không có giới hạn, một ứng dụng mất kiểm soát có thể tiêu tốn hàng nghìn đô la credit AI

- An toàn là quan trọng — Bạn có thể muốn giới hạn mô hình AI nào được sử dụng và chúng có thể làm gì

Tính năng chính

| Tính năng | Mô tả |

|---|---|

| API thống nhất | Một endpoint API để truy cập 100+ mô hình AI từ bất kỳ nhà cung cấp nào |

| Phát hiện bí mật | Tự động phát hiện và ẩn API key, mật khẩu và token trong prompt |

| Từ khóa bị chặn | Chặn yêu cầu chứa từ khóa nguy hiểm (hack, exploit, jailbreak) |

| Kiểm duyệt nội dung | Lọc nội dung bạo lực, có hại hoặc không phù hợp |

| Phát hiện prompt injection | Phát hiện và chặn các nỗ lực jailbreak |

| Giới hạn tốc độ | Kiểm soát số yêu cầu AI mỗi ứng dụng có thể thực hiện |

| Định tuyến mô hình | Định tuyến các yêu cầu khác nhau đến các mô hình AI khác nhau |

| Xác thực master key | Một master key duy nhất để xác thực API |

| Logic thử lại | Tự động thử lại yêu cầu thất bại (tối đa 3 lần) |

Guardrails tích hợp sẵn

AI Security được cấu hình sẵn với bốn guardrails bảo mật:

Phát hiện bí mật

Từ khóa bị chặn

Kiểm duyệt nội dung

Phát hiện Prompt Injection

Tính năng bảo mật

Kiểm soát truy cập

- Kiểm soát ứng dụng nào có thể truy cập dịch vụ AI

- Đặt quyền theo người dùng hoặc theo ứng dụng

- Giới hạn truy cập vào các mô hình AI cụ thể

Giới hạn tốc độ

- Đặt giới hạn số yêu cầu AI có thể thực hiện mỗi phút/giờ/ngày

- Ngăn chi phí phát sinh từ ứng dụng hoạt động sai

- Sử dụng công bằng giữa nhiều ứng dụng

Giám sát

- Theo dõi mức sử dụng AI API trên tất cả ứng dụng

- Xem ứng dụng nào thực hiện nhiều yêu cầu AI nhất

- Giám sát chi phí theo thời gian thực

Yêu cầu trên OpenCloud

| Yêu cầu | Chi tiết |

|---|---|

| Loại | Addon (dịch vụ hệ thống) |

| Cơ sở dữ liệu | Không yêu cầu |

| Gói | Gói addon cố định (1 CPU, 2 GB RAM, ~$1/tháng) |

| Cổng mặc định | 4000 |

| Network alias | litellm.proxy (dùng bởi các ứng dụng khác để tìm AI Security) |

Cài đặt

Triển khai từng bước

- Triển khai AI Security (LiteLLM)

- Từ sidebar dự án, vào Bảo mật AI

- Chọn Bật GuardRails để triển khai addon LiteLLM

- Chờ 3-5 phút cho đến khi AI Security hoạt động

- Sau khi triển khai, bạn sẽ thấy trạng thái "GuardRails đang hoạt động"

- Ghi chú: AI Security hoạt động như một proxy — tất cả yêu cầu AI từ các ứng dụng khác sẽ đi qua nó để được bảo vệ

- Lấy master key

- Vào ứng dụng LiteLLM > Environment Variables

- Tìm

LITELLM_MASTER_KEY— đây là API key mà ứng dụng dùng để kết nối

- Truy cập bảng điều khiển quản trị

Mở liên kết LiteLLM để truy cập bảng điều khiển quản trị.

Kết nối ứng dụng

Các ứng dụng khác trong project có thể kết nối với AI Security qua network alias nội bộ:

| Thiết lập | Giá trị |

|---|---|

| API Base URL | http://<project-id>.runopen.cloud (nội bộ) hoặc URL công khai của LiteLLM |

| API Key | Giá trị LITELLM_MASTER_KEY của bạn |

Thêm mô hình AI

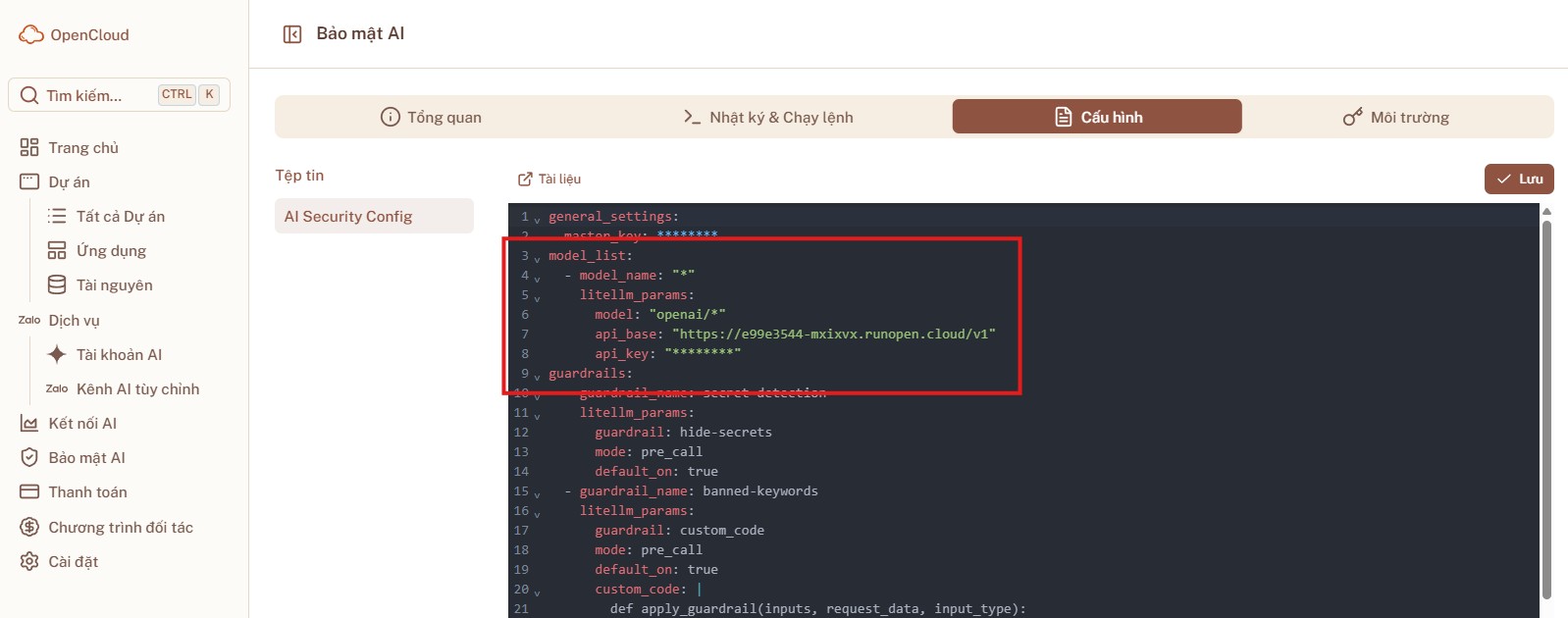

Cấu hình mô hình AI nào khả dụng:

- Mở Cấu hình

- Thêm mô hình:

model_list: - model_name: "*" litellm_params: model: "openai/*" api_base: "YOUR_LLM_ENDPOINT" api_key: "YOUR_LLM_API_KEY" - Lưu cấu hình

Cấu hình Guardrails

Bốn guardrails được kích hoạt mặc định:

| Guardrail | Chế độ | Chức năng |

|---|---|---|

| Secret Detection | Pre-call | Ẩn API key và mật khẩu trước khi gửi đến AI |

| Banned Keywords | Pre-call | Chặn từ khóa nguy hiểm |

| Content Moderation | Pre-call | Lọc nội dung có hại |

| Prompt Injection | Pre-call | Chặn các nỗ lực jailbreak |

Để tùy chỉnh guardrails, cập nhật biến môi trường LITELLM_GUARDRAILS hoặc chỉnh sửa cấu hình qua bảng điều khiển quản trị.

Cấu hình

| Thiết lập | Mặc định | Mô tả |

|---|---|---|

LITELLM_MASTER_KEY | Tự động tạo | Master API key để xác thực |

LITELLM_GUARDRAILS | [] (dùng mặc định từ file cấu hình) | Cấu hình guardrail tùy chỉnh |

| Request timeout | 120 giây | Thời gian tối đa cho yêu cầu AI |

| Retries | 3 | Số lần tự động thử lại khi thất bại |

Cách các ứng dụng OpenCloud khác sử dụng AI Security

| Ứng dụng | Tự động? | Cách kết nối |

|---|---|---|

| CoPaw | Có | Tự động cấu hình làm nhà cung cấp LLM mặc định |

| OpenClaw | Thủ công | Đặt tiền tố mô hình thành litellm/ (xem hướng dẫn tích hợp) |

| n8n | Thủ công | Đặt OPENAI_API_BASE thành URL LiteLLM trong workflow credentials |

Khắc phục sự cố

| Vấn đề | Giải pháp |

|---|---|

| Ứng dụng không kết nối được | Kiểm tra LITELLM_MASTER_KEY khớp ở cả hai ứng dụng |

| Yêu cầu AI thất bại | Xác minh API key nhà cung cấp AI trong cấu hình |

| Guardrails chặn yêu cầu hợp lệ | Tùy chỉnh thiết lập guardrail để giảm false positive |

| Độ trễ cao | AI Security thêm rất ít overhead; kiểm tra nhà cung cấp AI phía dưới |